20.12.2023 17:25

Що таке багатошаровий персептрон (Multilayer Perceptron, MLP) у машинному навчанні?

Багатошаровий персептрон (MLP) — це тип штучної нейронної мережі, який часто називають «класичною» нейронною мережею. Це фундаментальна архітектура, яка заклала основу для більш складних моделей глибокого навчання і продовжує використовуватися в різних додатках штучного інтелекту.

Що таке MLP

У складному гобелені штучного інтелекту лише кілька ниток є настільки ж важливими, як багатошаровий персептрон (MLP). Ця архітектура, що є різновидом нейронної мережі прямого поширення, існує свідченням прагнення людини імітувати здатність мозку до навчання. Її оманливо проста структура — взаємопов’язані шари штучних нейронів — приховує дивовижну здатність розгадувати складні закономірності та вирішувати реальні проблеми.

В основі MLP лежить окремий нейрон. Подібно до біологічних аналогів, ці обчислювальні одиниці отримують вхідні дані, підсумовують їх за допомогою зважених зв’язків і застосовують функцію активації для генерації вихідних даних. Цей, здавалося б, буденний процес, що повторюється на всіх рівнях, дозволяє мережі виокремлювати все більш складні ознаки з даних, з якими вона стикається. На відміну від одношарових персептронів, обмежених лінійними зв’язками, MLP з їхніми прихованими шарами досягають успіху в опануванні нелінійних складнощів, що є самою суттю багатьох реальних проблем.

Ця універсальність вивела MLP на передові позиції в різних галузях ШІ. У сфері розпізнавання зображень MLP працюють у системах розпізнавання облич, автономної навігації транспортних засобів та аналізу медичних зображень. Їх здатність розпізнавати тонкі закономірності в значеннях пікселів лежить в основі точної ідентифікації об’єктів і виявлення аномалій. Аналогічно, у сфері обробки природної мови MLPs працюють у механізмах машинного перекладу, аналізу настроїв і взаємодії з чат-ботами. Їхнє вміння розшифровувати нюанси людської мови відкриває світ інтелектуального спілкування та вилучення інформації.

Як працює MLP

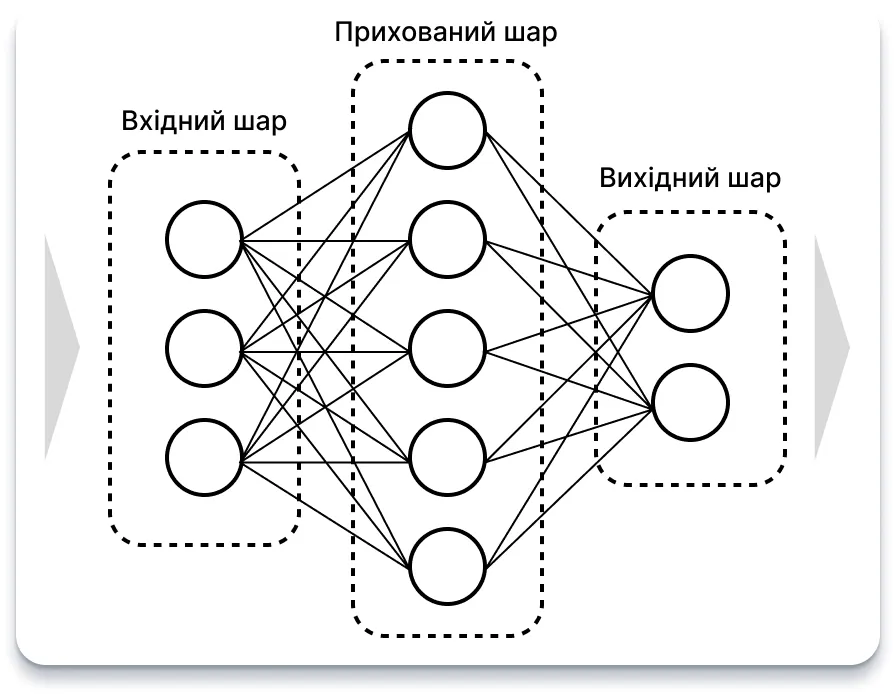

Уявіть собі MLP як багатошарову «лазанью». Вона складається щонайменше з трьох шарів взаємопов’язаних вузлів, які називаються нейронами:

- Вхідний шар: Отримує початкові дані, наприклад, пікселі зображення або слова речення.

- Прихований шар (шари): це робочі конячки мережі, де відбуваються складні обчислення та вилучення ознак. Прихованих шарів може бути один або декілька, кожен з яких має різну кількість нейронів.

- Вихідний шар: Видає остаточний прогноз або результат, заснований на обробці, виконаній на попередніх шарах.

Нейрони в кожному шарі з’єднані з нейронами в наступному шарі за допомогою зважених “синапсів”. Ці ваги визначають, наскільки сильно кожен вхід впливає на вихід нейрона.

Кожен нейрон застосовує функцію активації до своєї зваженої суми входів. Ця функція вносить нелінійність, дозволяючи мережі вивчати складні взаємозв’язки в даних. Популярні функції активації включають сигмоїдну та ReLU.

MLP навчаються за допомогою процесу, який називається зворотним поширенням. Під час навчання мережа робить прогнози на наборі даних, порівнює їх з фактичними значеннями, а потім коригує ваги у зв’язках, щоб мінімізувати похибку. Цей ітеративний процес поступово налаштовує мережу на зіставлення входів з бажаними виходами.

У чому різниця між MLP та ANN

І багатошарові персептрони (MLP), і штучні нейронні мережі (ANN) є важливими поняттями в галузі штучного інтелекту (ШІ). Однак між ними є ключова відмінність:

MLP — це особливий тип штучних нейронних мереж. Уявіть собі, що це певний вид автомобіля в ширшій категорії транспортних засобів. Всі MLP є ANN, але не всі ANN є MLP.

Структура MLP — це пряма архітектура з взаємопов’язаними шарами нейронів, тоді як ANN може мати різні архітектури, включаючи пряму, рекурентну та згорткову.

MLP повинна мати щонайменше три шари: вхідний, прихований і вихідний, тоді як ANN може мати будь-яку кількість шарів, включаючи одношарові мережі

Нейрони MLP в кожному шарі повністю з’єднані з нейронами в наступному шарі, тоді як поєднання в ANN можуть бути повністю з’єднані, частково з’єднані або мати цикли

MLP добре працює в розпізнаванні зображень, обробці природної мови, обробці сигналів, системах управління, а ANN — в різних додатках, залежно від конкретної архітектури, включаючи розпізнавання мови, робототехніку та ігровий ШІ.

Найбільш актуальні сфери застосування багатошарових персептронів

MLP є універсальними і знайшли застосування в різних сферах, зокрема:

- Розпізнавання зображень: Ідентифікація облич, об’єктів і сцен на зображеннях.

- Обробка природної мови: Машинний переклад, аналіз настроїв і класифікація тексту.

- Обробка сигналів: Розпізнавання мови, аналіз медичних зображень та фінансове прогнозування.

- Системи керування: Робототехніка, автономні транспортні засоби та ігровий ШІ.

Сильні сторони:

- Простота і зрозумілість: Структуру та функції MLP відносно легко зрозуміти порівняно з більш складними моделями глибокого навчання.

- Гнучкість: Можна адаптувати до різних завдань, змінюючи кількість шарів і нейронів, вибираючи різні функції активації та використовуючи різні алгоритми навчання.

- Міцний фундамент: MLP слугують будівельними блоками для багатьох передових архітектур глибокого навчання.

Слабкі сторони:

- Обмежена здатність обробляти складні дані: Може мати проблеми з даними високої розмірності, такими як природна мова або великі зображення.

- Обчислювально дорогий: Навчання може бути повільним і вимагати значних ресурсів, особливо для великих наборів даних.

- Природа «чорної скриньки»: Хоча до певної міри можна інтерпретувати, розуміння внутрішньої роботи навченого MLP може бути складним завданням.

Висновок

З розвитком ШІ MLP залишатиметься наріжним каменем. Притаманна йому гнучкість і можливість інтерпретації продовжує приваблювати дослідників і розробників. Його інтеграція з новітніми архітектурами глибокого навчання, такими як згорткові нейронні мережі, відкриває ще більший потенціал. Цей симбіоз обіцяє ще більше розширити межі штучного інтелекту, відкриваючи майбутнє, в якому люди і машини співпрацюватимуть для вирішення все більш складних завдань.

Насамкінець, багатошаровий персептрон – це не просто механізм штучного інтелекту, це свідчення винахідливості людського інтелекту. Його шлях від зародження до повсюдного поширення свідчить про наше прагнення зрозуміти і відтворити людський розум. Оскільки сфера штучного інтелекту продовжує розвиватися, зірка MLP, ймовірно, сяятиме яскравіше, освітлюючи шлях до майбутнього, в якому розумні машини переплітаються з нашим життям.

)

)

)

)

)

)

)

)