23.02.2024 12:22

Meta Reality Labs представила Lumos, нову мультимодальну систему запитань-відповідей

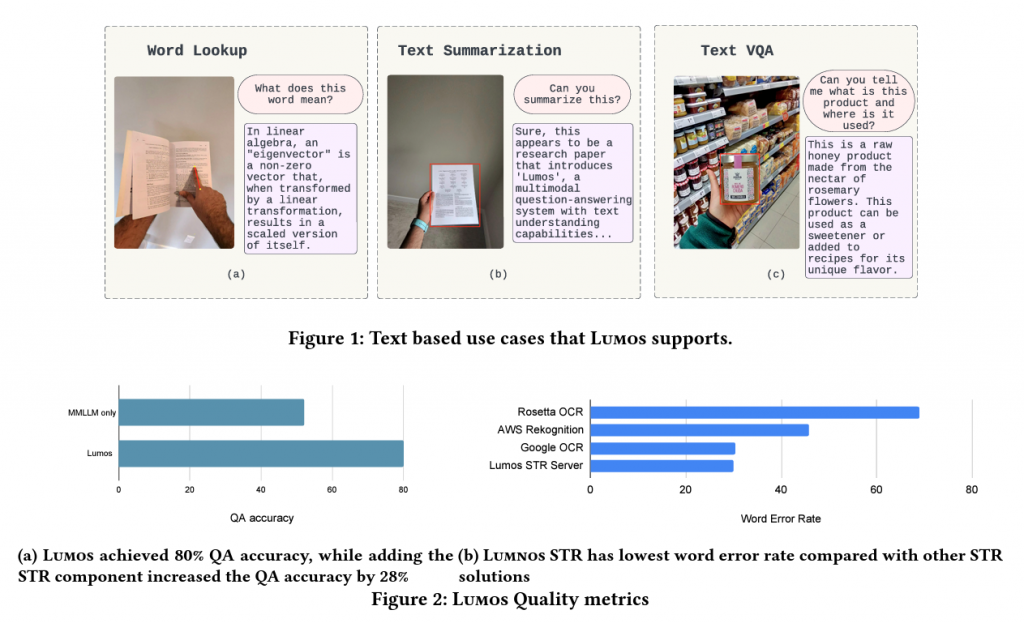

Meta Reality Labs представила Lumos — першу у своєму роді мультимодальну систему запитань і відповідей, яка має можливість розуміти текст, витягувати його з зображень та покращувати вхідні дані для мультимодальних великих мовних моделей (MM-LLM). Цей продукт є результатом значних досліджень у галузі штучного інтелекту і розробок Meta Reality Labs.

Існують деякі виклики у розробці мультимодальних систем, особливо пов’язані з розумінням тексту на зображеннях. Традиційні методи оптичного розпізнавання символів (OCR) мають обмежену ефективність при роботі з різноманітними форматами тексту, різними шрифтами та орієнтацією. Lumos розв’язує ці проблеми завдяки новому компоненту Scene Text Recognition (STR), який дозволяє точно виділяти та розуміти текст на зображеннях.

Команда Meta Reality Labs ретельно розробила STR для забезпечення високої точності виокремлення тексту з будь-яких зображень, незалежно від їх формату та складності. Це дозволяє Lumos працювати з різноманітними типами даних та надавати точні та зрозумілі відповіді на запитання користувачів.

Однією з ключових переваг Lumos є його ефективність у реальному часі. Він забезпечує миттєву відповідь на запити користувачів, оптимізуючи обробку даних та використання моделей штучного інтелекту. Це робить його ідеальним рішенням для широкого спектра застосувань, від розумних асистентів до систем розпізнавання образів у реальному часі.

Нагадаємо, Microsoft Azure AI розширює вибір моделей завдяки Llama 2 і GPT-4 Turbo з функцією Vision.

)

)

)